|

Nanotecnología:

Nanotecnología:

Un nanómetro es la mil millonésima parte de un metro. Debido a efectos cuánticos las propiedades físicas y químicas de la materia cambian a escala nanométrica. La conductividad eléctrica, el calor, la resistencia, la elasticidad, la reactividad, entre otras propiedades, se comportan de manera diferente que en los mismos elementos a mayor escala.

El desarrollo de la fabricación de estructuras y objetos con una precisión de nanómetros ha permitido la comercialización de nuevos productos como válvulas cardiacas, componentes electrónicos, electrodomésticos, pinturas resistentes al rayado, equipos deportivos, telas antiarrugas, antimanchas, cremas dentales propiciando un mercado que mueve 2.500 millones de euros. Se estima que en 2010 se alcanzarán los cientos de miles de millones, para llegar al billón poco más tarde.

Algunos denominan nanotecnología pasiva a la fabricación de materiales, pero no dispositivos, que muestran algún tipo de comportamiento relacionado con las propiedades de la materia a escala nanométrica como por ejemplo telas de materiales cuya estructura posee propiedades eléctricas particulares que evitan la fijación de las manchas.

Aplicaciones futuras:

La nanotecnología promete grandes beneficios para campos como la producción agrícola, el diagnóstico de enfermedades, el procesamiento de alimentos, la construcción o la detección y control de plagas. La nanomedicina es una de las áreas que más puede contribuir al avance sostenible del Tercer Mundo, proporcionando nuevos métodos de diagnóstico y detección de enfermedades, mejores sistemas para la administración de fármacos y herramientas para la monotorización de algunos parámetros biológicos. Se podrían generar microcápsulas inteligentes capaces de atacar sólo las células afectadas por el cáncer, liberando la toxina o radionucleótido exclusivamente en la zona enferma, sin dańar el tejido sano. Se contempla también la posibilidad de la inhalación de drogas, proteínas o insulina encapsulada que evitaría las inyecciones. Los alimentos podrían distribuirse envasados en plásticos inteligentes que detectan la contaminación y se biodegradan una vez tirados a la basura.

Las nanopartículas presentan cierta toxicidad potencial y podrían deteriorar las membranas celulares o desregular el sistema inmunológico cuando son inhaladas o ingeridas.

Los científicos son partidarios del su uso creciente por el número de ventajas que ofrecerán frente a las posibles consecuencias adversas.

Ritmo de avance en la integración:

Ritmo de avance en la integración:

En 1965, Gordon Moore, uno de los fundadores de Intel, indicó que la densidad de los circuitos integrados se duplicaría cada 24 meses. Esta afirmación se hace realidad ańo tras ańo con cada vez más potentes y diminutos procesadores que están permitiendo novedosas aplicaciones en el ámbito profesional y el doméstico.

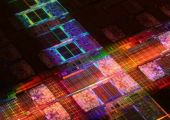

Es frecuente la fabricación de transistores con tamańos menores de 100 nanómetros, el tamańo del virus de la gripe. Actualmente la tecnología de fabricación de Intel es de 65 nm que será rebasada por los nuevos procesadores con tecnología de 45 nm, llamados Penryn.

La aplicación de la nanotecnología al mundo de la informática ha traído un amplio número de beneficios como el aumento de las capacidades de procesamiento y la reducción de costes, tal y como establece la ley de Moore. El avance permite reducir el consumo de energía y favorece la integración de los procesadores. Cuando Intel anuncia el logro de una tecnología de fabricación que pasa de los 65 a los 45 nanómetros significa que se consigue un 20% más de rendimiento y un 20% menos de consumo en el procesador. Intel trabaja actualmente en la tecnología de 32 nm y 22 nm.

No se trata tan sólo de hacer transistores pequeńos y de progresar en la miniaturización de componentes. IBM consiguió un avance importante con materiales que se autoensamblan [airgrap]. Se emplean también tecnologías para el desarrollo de nuevos dispositivos como la de los nanotubos de carbono, los nanocables semiconductores, los spintronics o electrónica molecular.

Fabricación de microcircuitos:

Los microcircuitos se construyen a base de crear e interconectar transistores sobre una lámina de silicio para formar sistemas electrónicos complejos. El proceso de fabricación consta de una serie de ciclos de etapas que se repiten hasta veinte veces. A partir de un sustrato u oblea preparada de silicio, de un tamańo de 200 mm y recubierto de un material fotosensible (habitualmente un polímero), se obtienen muchas pastillas (chips) a la vez. Mediante una máquina posicionadora, similar a una ampliadora fotográfica, se expone el polímero a la luz. La máquina posee un retículo o máscara que proyecta repetidamente un patrón distinto sobre la oblea, formándose una pastilla en cada posición donde recae la imagen (fotolitografía). A continuación se elimina el recubrimiento fotosensible. Se ataca luego con gases las zonas expuestas a la luz no protegidas por el polímero y se bombardean con iones (dopado) para crear transistores. En los sucesivos siclos se ańaden capas de metal y de aislante que forman las conexiones entre transistores. Para fabricar una pastilla se requieren unas 19 capas.

Límites de la integración:

Límites de la integración:

Aunque la reducción a escala ha comportado muchas de las hazańas tecnológicas de la electrónica del silicio, la tendencia no puede proseguir indefinidamente. Los diseńos de las pastillas empiezan a toparse con los límites físicos de la miniatrurización. Se han abierto líneas de investigación que, en vez de recurrir a a la miniaturización para mejorar la velocidad y la versatilidad de los dispositivos, se inclinan por el uso de materialesen los que los electrones se desplazan a velocidades mayores, logrando así un funcionamiento más rápido. Con estos materiales, basados en aleaciones de silicio y germanio, pueden obtenerse transistores de altísima velocidad. Otras aleaciones como las de hierro y silicio (siliciuros) son también objeto de interés por sus posibilidades de integración de componentes magnéticos, ópticos y electrónicos en un mismo dispositivo.

Top 500:

Los superordenadores que disponen de procesadores capaces de realizar una cantidad ingente de instrucciones complejas a gran velocidad, a magnitudes del orden de billones de operaciones numéricas por segundo (teraflops). Su uso es creciente en aplicaciones como la meteorología, la medicina o la generación de gráficos para el cine. La lista Top 500 recoge de manera periódica los 500 mayores. En 2002 fue el complejo Simulador terrestre, instalado ese mismo ańo en Yokohama, el que ocupó el primer lugar con más de 35 billones de operaciones, más de 4,5 veces que su antecesor en la lista, el ASCI White, de I.B.M. Algo más de la capacidad en supercomputación de los ordenadores de la lista se encuentran localizados en EE.UU. Por marcas, I.B.M. engloba la tercera parte y H.P. una quinta parte. La nueva supercomputadora planeada por IBM, el IBM Roadrunner, será un híbrido entre procesadores de propósito general CISC y procesadores Cell. Se dice que esta combinación producirá el primer ordenador capaz de operar a la velocidad del petaflop.

Cibernética:

Norbert Wiener definió la cibernética como el estudio del control y la comunicación en el animal y en la máquina. Pero la realización de este proyecto no es tan sencillo como esa frase, porque la penetración de la cibernética, la inteligencia artificial de las máquinas en el mundo contemporáneo alcanza a todos los campos: la biología, la psicología, la sociología, la ingeniería, las matemáticas, el arte, la filosofía y la lingüística. De ahí que aquella definición de Wiener haya sido cambiada por otra más simple pero mucho más compleja: ciencia del control y la comunicación. En esta frase queda encerrado todo, porque la amplitud del campo de acción ha ido reduciendo la definición: todas las áreas del conocimiento, y sobre todo, las ciencias que se entrecruzan para tratar de resolver problemas hasta estas últimas décadas impensables, se ven afectadas por esta revolución de las máquinas que informan, eligen, recuerdan, razonan, hablan, traducen,, retienen, etc. Introducirse en la cibernética pasa por adentrarse en el lenguaje propio de las máquinas, en su lógica pensante que constituye la base de su actuación.

Estamos acostumbrados a contar los objetos por decenas. Diez unidades forman una decena; diez decenas son una centena, y así sucesivamente. Nuestro sistema numérico se llama decimal. En Cibernética está más difundido otro sistema: el binario. Para contar los objetos de acuerdo con este sistema hay que hacerlo por pares. De estes modo, en el sistema binario, el papel de la decena lo desempeńa el par: dos unidades de primer grado forman un par o una unidad de segundo grado. Dos unidades de segundro grado, o dos pares, forman una unidad de tercer grado. Bien es verdad que esta unidad carece de un nombre, como el que tiene la centena. Dos unidades de tercer grado forman una unidad de cuarto grado, y así sucesivamente. Veamos cómo deben anotarse las cifras que se obtienen cuando se cuentan objetos por el sistema binario.

- Uno: 1

- Dos: 10 (Una unidad de segundo grado)

- Tres: 11

- Cuatro: 100 (Una unidad de tercer grado)

- Cinco: 101

- Seis: 110

- Siete: 111

- Ocho: 1000 (Una unidad de cuarto grado)

Primeras calculadoras:

El ábaco, de gran utilidad para sumar y restar fue probablemente inventado por los babilonios. En 1623 el alemán Willhelm Schickard construye un aparato con una rueda dentada capaz de resolver las cuatro reglas básicas. En 1644 Blaise Pascal crea un aparato para sumar y restar números de hasta 8 cifras. La pascalina estaba basada en ruedas dentadas interrelacionadas, cuya rotación completa de una de ellas hacía girar un paso a la rueda siguiente.

En 1671 Gottfried Willhelm Leibniz crea un mecanismo de cilindros capaz de realizar automáticamente las cuatro reglas básicas. Su modelo de 1694, partiendo de los de Pascal y Samuel Morland realizaba también raíces cuadradas. Este mecanismo fue bautizado con el nombre de rueda escalada de Leibniz.

Microcircuito (1971):

Desarrollado por Intel Corporation a solicitud de una empresa japonesa que había previsto sobre el papel las ventajas de la invención.

Pronto se creó un sector industrial de billones de dólares y cientos de miles de empleados.

Los miniordenadores de los ańos 60 oscilaban entre los 16 y 32 K de memoria, en los 80 entre los 128 y 256 K. A principios de los 80 los ordenadores personales doblaban su capacidad cada ańo (16, 32, 64, 128 K). Cuando en esta generación de ordenadores se empiezan a sustituir las memorias de núcleos magnéticos de ferrita existía el inconveniente del alto precio de los chips. Con el rápido crecimiento de su fabricación en serie el precio bajó a gran velocidad.

Unidades de estado sólido (2015):

Los SSD son superiores en tamańo, peso, resistencia y velocidad aunque su precio es más alto.

Según TrendForce en 2017 saldrá más a cuenta comprar una unidad de estado sólido que un disco duro. Su precio ha caído un 40% desde 2012 y la tendencia se acentúa.

La demanda y la competencia seguirán abaratando los costes de las memorias NAND mientras que el precio de los discos duros se estabilizará por la longevidad de la tecnología.

Los discos duros con más espacio seguirán siendo más baratos, pero los precios de los SSD habrán caído tanto que los fabricantes de ordenadores preferirán sacrificar unos gigas para ofrecer mayor rendimiento. TrendForce estima que en 2017 una unidad SSD de 256 GB costará unos 40 dólares, mientras que un disco duro de 500 GB se quedará en 30. Con los servicios de streaming y los costes actuales del almacenamiento en la nube, es difícil pensar que los fabricantes de portátiles elijan la segunda opción.

El gráfico de la adopción del SSD en portátiles también se dispara. En 2015, un 24% de los portátiles salió de fábrica con un SSD. Para 2016 estiman un 31%. Y en 2017, el 41%.

La tecnología de las memorias NAND y los conectores e interfaces de los SSD continuarán evolucionando para ser todavía más rápidos que los discos duros.

|